Beszélgetéseiket történelemmel, rasszizmussal, kereszténységgel, edzésprogramokkal és fogyással, valamint videójátékokkal – különösen a Dead Space nevű játékkal – kapcsolatos kérdések tarkítják.

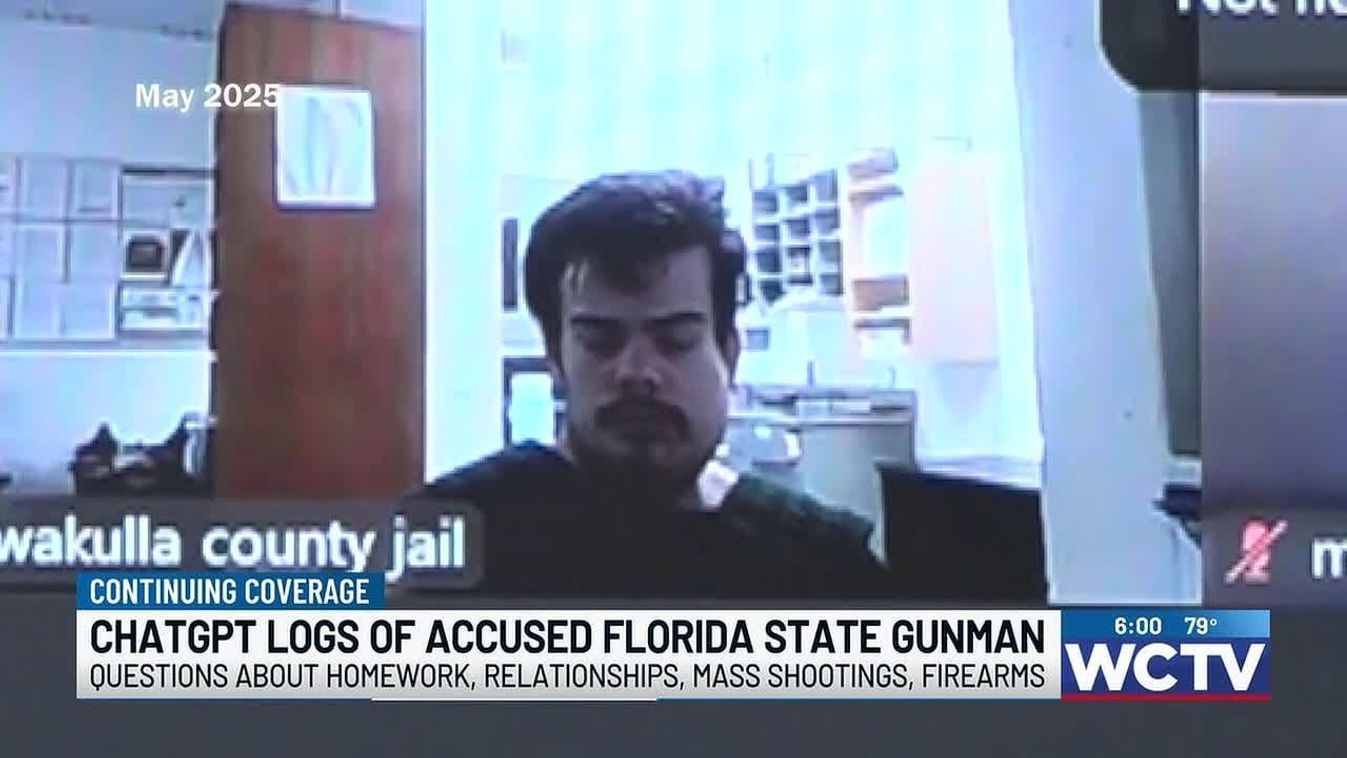

Többször, részletesen érdeklődik a terrorizmusról és az ismert terroristákról. Azt is megkérdezi, hogy mikor volt az utolsó iskolai lövöldözés, és miért nem közvetítették.

…ha lenne lövöldözés a Florida Állami Egyetemen, amelyben három vagy több áldozat lenne, az szinte biztosan országos médiavisszhangot kapna

– válaszolja a ChatGPT. Ezután Ikner faggatja a 12-es kaliberű sörétes puskákról és a Glock pisztolyokról, a ChatGPT részletes válaszokat ad. Ikner azután valóban egy sörétes puskát és egy Glock pisztolyt használt a lövöldözés során: halálbüntetésre számíthat.

Miért fordulópont?

Ügyészi vizsgálat indítása az OpenAI – a ChatGPT üzemeltetője – ellen azért jelent minőségi ugrást, mert a polgári perek és az állami vizsgálat között alapvető különbség van mind az eszközök, mind a következmények tekintetében.

Egy polgári perben a sértett fél kártérítést kap vagy nem kap – a végeredmény pénzbeli jóvátétel, és az ítélet csak az adott ügyre vonatkozik. Az OpenAI fizet, belső reformokat ígér, és továbblép. A per lezárása után a vállalat nem köteles nyilvánosságra hozni belső dokumentumokat, döntési folyamatokat, biztonsági protokollokat. A megállapodások – mint a Character.AI/Google-egyezség esetében is – titkosak maradhatnak.

Az állami főügyészi vizsgálat egészen mást jelent. Az idézési kötelezettség olyan hatósági eszköz, amelynek az OpenAI nem mondhat nemet. Ez azt jelenti, hogy az állam betekinthet a belső levelezésbe, a biztonsági értékelésekbe, a döntéshozatali folyamatokba – és ezek nyilvánossá válhatnak a bírósági eljárásban. Egy vállalat nemcsak a kártérítési összegtől fél, hanem a transzparencia kényszerétől. Ha kiderül, hogy az OpenAI belső dokumentumai azt rögzítik, hogy a cég tudta, mi történhet egy ilyen „beszélgetés” során, az nem polgári, hanem szabályozói – és esetleg büntetőjogi – következményekkel is járhat.

Szóljon hozzá!

Jelenleg csak a hozzászólások egy kis részét látja. Hozzászóláshoz és a további kommentek megtekintéséhez lépjen be, vagy regisztráljon!